イベント

AIの現在と未来を提示するセミナー「AI MEETUP 2 AIキャラクタービジネス最前線」をレポート。キャラクターAIと自由に囁き合う日も遠くない?

|

このイベントは,AIキャラクタービジネスの最新トレンドや,新たなAIテクノロジーの開発,そしてそれらを使った未来を模索するトークセションを中心としたセミナーで,今回が2度めの開催となる。本稿では,2部構成で行われたセミナーの内容をレポートしよう。

まっさらな人工知能は,堕落することで成長する?

第1部は,「なぜ人工知能は人と会話をできるのか」をテーマに,人工知能の基本的な概念や,人工知能とキャラクターの組み合わせによる会話技術,そこから発展するビジネスについて,AI開発者である三宅陽一郎氏が解説を行った。

|

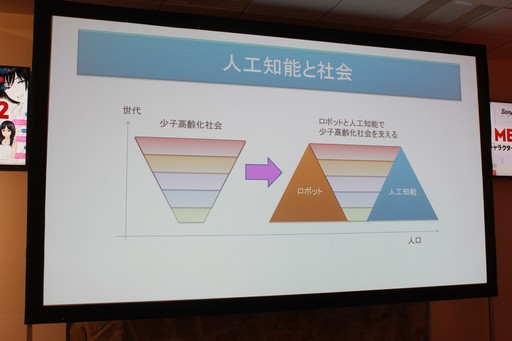

三宅氏は,人工知能は社会に溶け込みつつあるという現在の状況について,「よく人工知能が仕事を奪うと言われるが,少子高齢社会となりつつある日本としては,むしろ人工知能に仕事を奪ってもらわないと成り立たず,ロボットと人工知能に社会を支えてもらうことになる」という見解を述べた。

そして,ロボットや人工知能,人間とが協調していくために,言葉によるコミュニケーションを通じて,お互いを理解することが必要であると持論を展開。その際に欠かせないのが人工知能のキャラクター化で,姿のない人工知能や四角い箱のような人工知能よりも,動物や人の姿をした人工知能のほうが,人の心を和らげる心理効果をもたらすことを挙げ,そういったキャラクターとして扱うことこそが,社会に人工知能を浸透させる大きなキーポイントだとした。

|

|

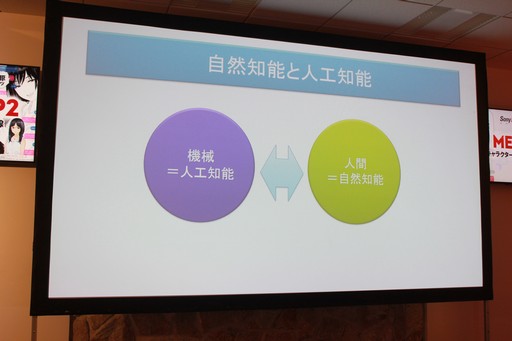

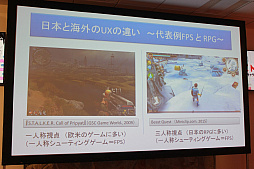

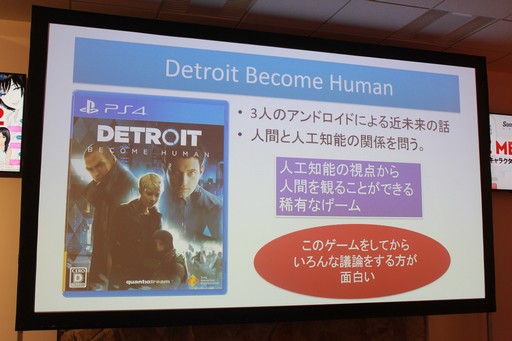

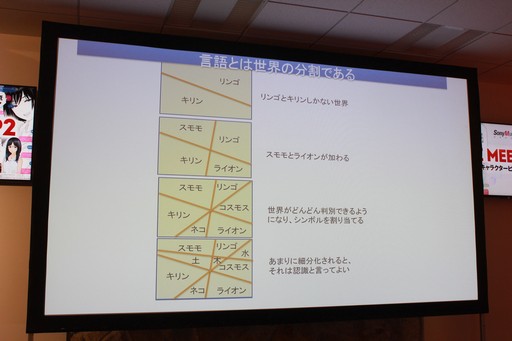

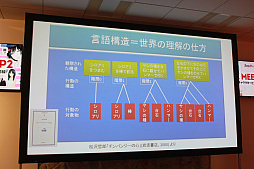

そもそも人工知能とは,人間のように自然発生した自然知能――言語構造を通して,世界を知覚した知能を機械に宿らせたものを指す。ただ,定義としては世界共通ではあるが,西洋では神から人,人から人工知能と縦の序列となっていて,人工知能はあくまでも人が使うツールのような立ち位置となっている。一方,東洋,とくに日本では,人も神も動物も人工知能もすべて同じ立ち位置,水平的な意識で扱う懐の広い文化的素養がある。この東洋的な考えは海外では驚くべきものと捉えられているが,三宅氏はこのような考えだからこそ,AIBOや初音ミクが生まれたと述べた。

|

|

|

|

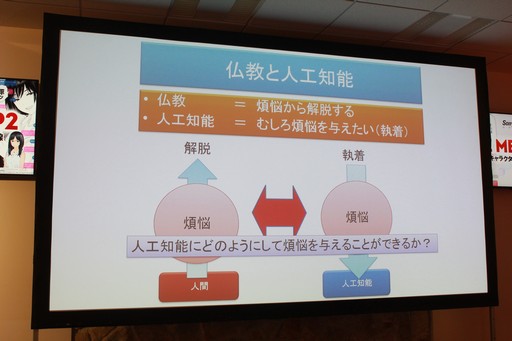

では,キャラクターを作るとは何かというと,「キャラクターに煩悩を与える」ことだという。例えばポリゴンのキャラクターを作って,ゲームの世界にポンと置いたとしても,キャラクターは微動だにせず,世界になにも執着しない。何の欲求も持っておらず,いわば解脱した状態なのだという。

三宅氏はそのキャラクターに「あいつは悪いヤツだ」「あいつを倒してみんなを守るんだ」といったことを1つ1つ覚えさせていくと,キャラクターはどんどん世界に執着する。つまり,解脱していたキャラクターに煩悩を与え,堕落させるということが,キャラクターを作ることなのだと述べた。この煩悩を与えるために大きな役割を果たすのが言語だ。

|

|

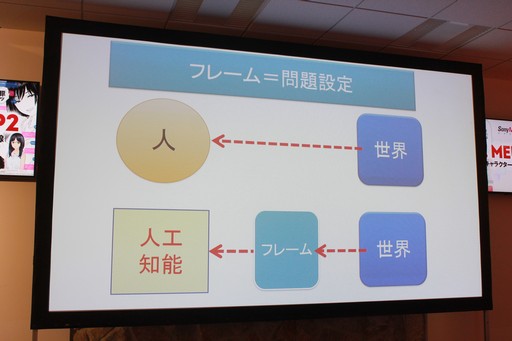

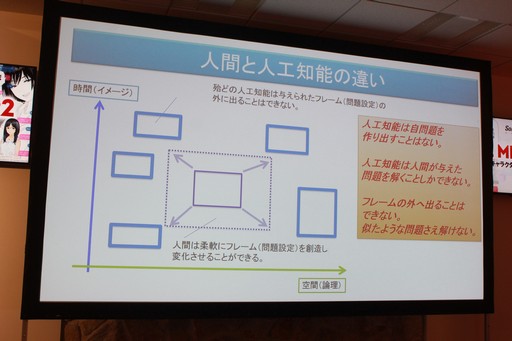

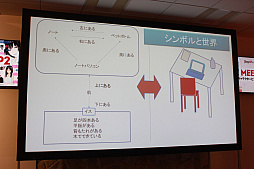

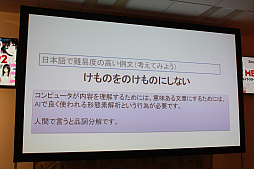

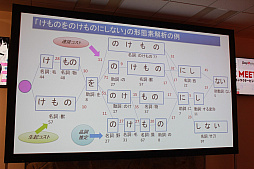

人間が世界をダイレクトに感じられるのは,自然知能を持ち,身体を持っているからだ。しかし,人工知能は身体がとても脆弱で,人工的に作られたが故に世界に根付いていない。だから,物事をどう捉えていいのか自分自身で理解する力がなく,人間がその理解に必要な事柄だけをまとめた「フレーム」を与えなくてはならない。このフレームは言語で構造化されており,言語を恣意的に押しつけることで賢くなり,言語構造が複雑化するほど,知能も高まっていくのだ。

|

|

|

|

|

|

|

|

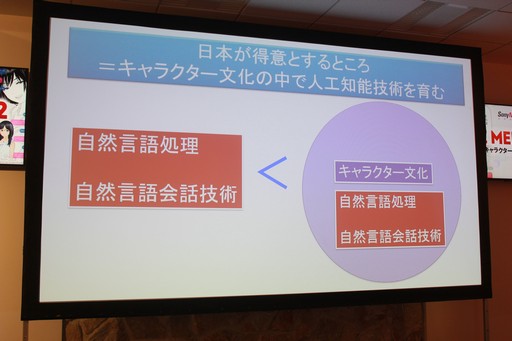

ただ,このような自然言語処理や会話技術は,日本では遅れている分野で,海外のほうが進んでいるという。しかも,現在,人工知能技術はモジュール化されていて,キャラクター文化と切り離されているのが全世界的に主流なのだとか。

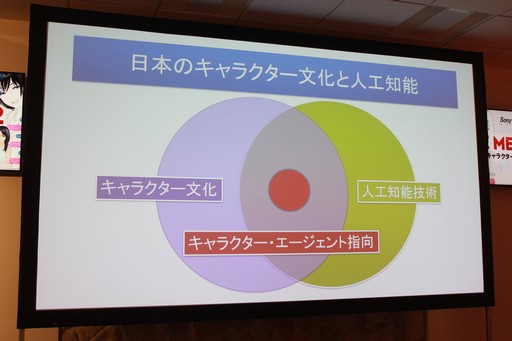

しかし三宅氏は,日本ではキャラクターに言葉をしゃべらせることに忌避感がなく,キャラクター文化と自然言語会話技術を結びつけられる強みがあると説明。これは「キャラクター・エージェント指向」と呼ばれ,今また流行りつつあると述べた。

キャラクターと人工知能の組み合わせは,長年ゲーム業界で取り組まれてきたが,現在はキャラクター化したロボットやスピーカーなどと人工知能とを,現実の世界で結びつけようという運動が大きくなりつつある。いずれ世界を驚かせるような数々の製品が作られることに期待したいとまとめた。

|

|

音声合成と人工知能の自然言語会話技術の最前線を紹介

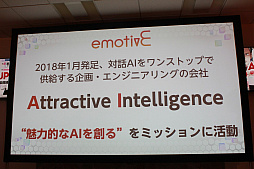

第2部は「音声合成と自由対話AIが切り拓くAIキャラクタービジネス」をテーマに,ソニー・ミュージックコミュニケーションズの松平恒幸氏,SMEの井上敦史氏,emotivE 代表取締役の結束雅雪氏,そしてスペシャルゲストとして声優の寿 美奈子さんが登壇し,クロストークが行われた。

|

|

最初のトピック「劇的に進化している最新の音声合成テクノロジー」では,松平氏が「先ほどの三宅さんから『キャラクターがしゃべる』というお話がありましたが,それを担うのが音声合成ではないかと我々は捉えてます」と語った。

|

音声合成というと,一節一節を区切る機械的なものをイメージすることが多いと思うが,そういったものは技術的には4,5年前の音声合成だと松平氏は説明する。

では,現在の音声合成はどのようなものか。ここで,寿さんが音声を担当したバーチャルアナウンサー「沢村碧」によるニュース原稿の読み上げが披露された。あまりにも滑らかにしゃべる合成された音声に驚いたが,これは「フルチューンされた,当代最強の合成音声(松平氏)」とのことで,とても納得できるものだった。ただ,これはあくまでニュースキャスターのトーンを突き詰めたもので,演技などはできないという。

|

声を当てた寿さんは,スタジオで沢村碧の声を聞いたとき,すごく驚いたという。合成音声の収録はアニメなどの収録とはまるで異なり「感情を抑えて,でもロボットにはならないようにという塩梅をキープしながら,ひたすらとくに意味のない一文を録り続けた」と,当時の様子をふり返る。

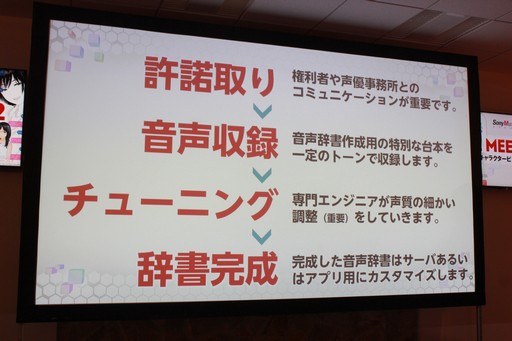

そこで松平氏は,音声合成のプロセスを公開した。

実は最初の許諾取りが一番大変で,版元に「まず音声合成とはどういうものか」という話し合いを行うことからスタートするのだという。

音声収録は,音声合成専用のナンセンスな言葉が並ぶ台本をひたすら読み上げてもらう。常に一定のトーンでしゃべることになるため,非常に技術がいるそうだ。松平氏によると「寿さんはめちゃんこうまかった」ため,とても助かったのだとか。

チューニングは,録音された音声をエンジニアが口調やイントネーションを調整していく作業で,収録時のクオリティが高いと,エンジニアの負担が軽減される。チューニングされた音声は,辞書としてまとめられ,これをアプリなどに組み込むことにより,テキスト情報を読み上げられるようになる。

|

このようにして作り上げられる音声合成だが,ベースとなる音声によって様々なキャラクターを演出することが可能で,相性がいいのが自由対話AIテクノロジーだと,松平氏はまとめた。

|

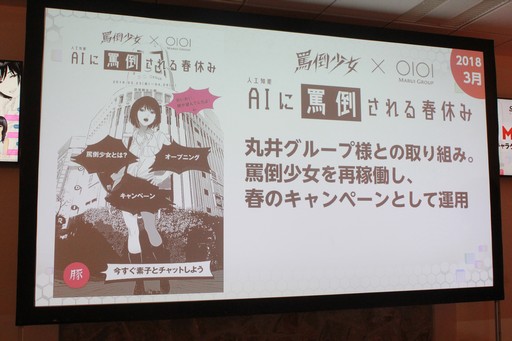

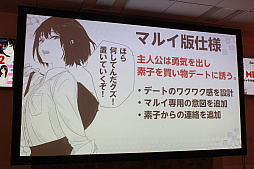

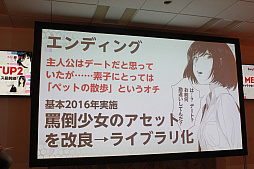

松平氏からバトンを受け取った井上氏は,2018年3月に行われた「罵倒少女×OIOI」キャンペーンを例に自由対話AIの説明を始めた。

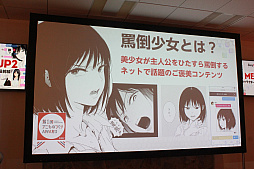

罵倒少女とは,井上氏と結束氏が手がけている「対話型人工知能サービス PROJECT samantha」が初めてAI化したキャラクターで,AI化された美少女とスマホでチャットし,ひたすら罵倒されるというサービスだ。AIには感情パラメータが組み込まれており,稀に「デレる」らしい。これをマルイとのキャンペーン用にアップグレードして採用されたという。

|

|

|

|

|

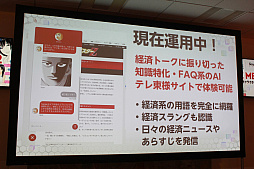

続いて結束氏が,経済系対話AI「神代部長に訊け」を紹介。これはテレビ東京系列で放送中のドラマ「インベスターZ」の公式サイトで運営されている会話AIで,経済用語の説明やドラマの補完,プロモーションなどを担っている。

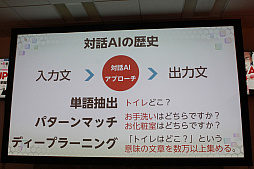

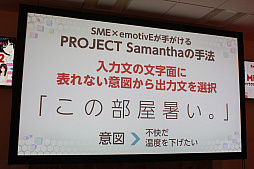

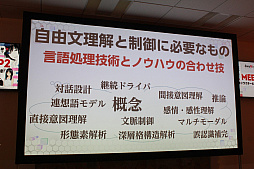

「罵倒少女」も「神代部長に訊け」も,キャラクターの人格を損なわず,会話を成立させるのは非常に難しいという。対話AIのアプローチとして,単語抽出やパターンマッチなどいくつかの方法があるが,「PROJECT samantha」では文字に表れない意図を汲んで応答するという手法で,自由会話に近づけているそうだ。もちろんそれは一筋縄でできるものではなく,様々な言語処理とノウハウの合わせ技で実現している。

|

|

|

|

|

|

|

|

|

|

|

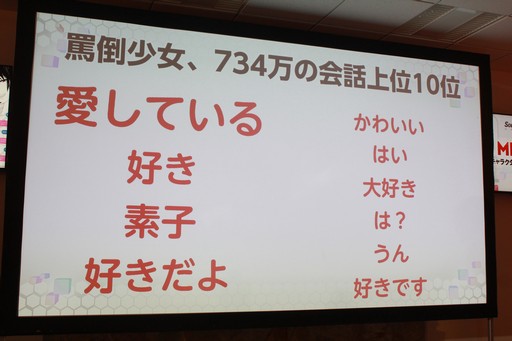

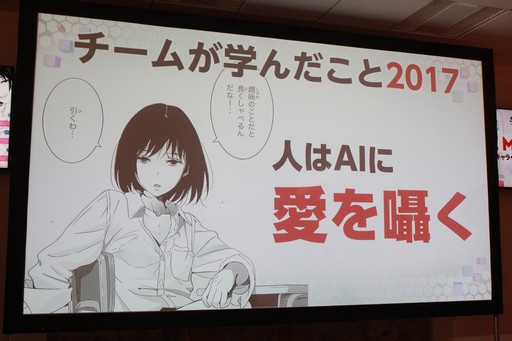

昨年開催された「AI MEETUP」から1年経ち,SMEが得た知見として,「罵倒少女」で交わされた会話トップ10を公開しつつ,「人はAIに愛を囁く」と井上氏は話す。これについて松平氏も「以前,リリースしたアプリ『めざましマネージャー アスナ』でも,3日間で数十万の対話が行われ,そのログを見ると,『好き』『可愛い』『愛している』という言葉が多かった」と述べた。

|

|

|

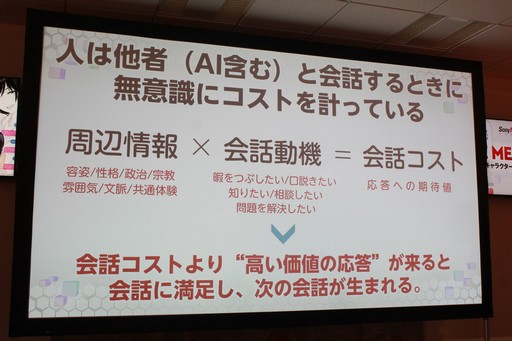

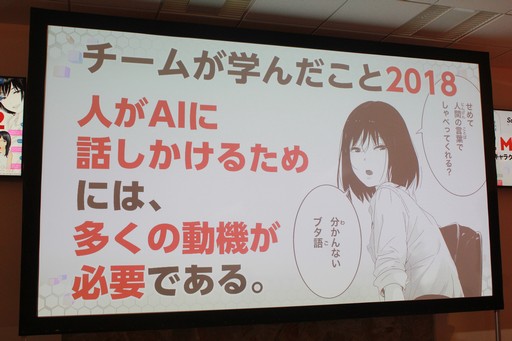

さらに井上氏は「人がAIに話しかけるためには,大きな動機が必要だ」と続ける。動機はAIに限らず,人と人との会話でも支払うコストである。

このコストについて結束氏は,人は話している最中に感情や欲求,経験などを無意識に分析してコミュニケーションを取っていると説明。これは人間のすごいところなのだが,AIとの会話にもこれを求めているという。つまり,AIにエンタメ性を求めるのであれば,「会話コスト以上の高い価値=満足できる会話」をできるようにせねばならず,ここが大きな壁になっていると語った。

|

|

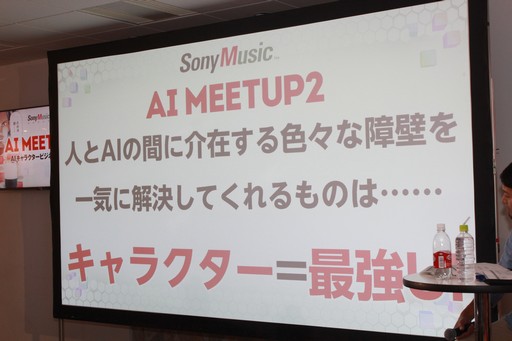

井上氏は,この会話コストの壁を解決する方法として,キャラクターを重視していると述べる。ユーザーはそのキャラクターを認知し,キャラクターとしゃべりたいという動機があるところからスタートしているため,会話コストが低く,またUIとしても最適で,多くの解決する方法のひとつと考えているとまとめた。

|

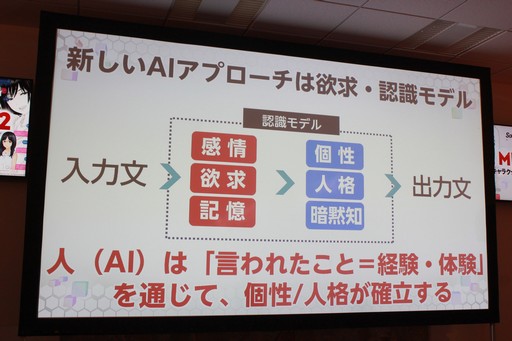

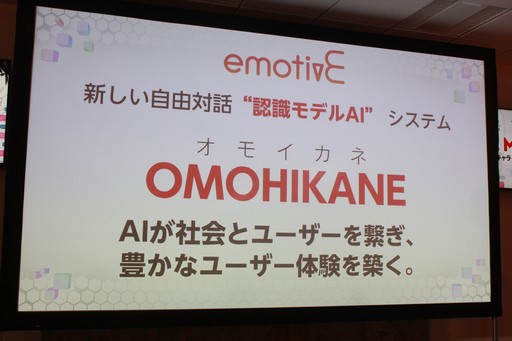

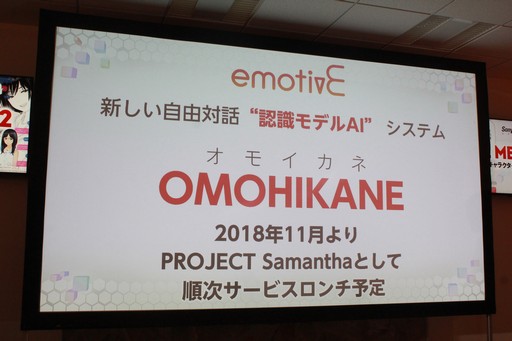

最後に新しい自由会話AIのテクノロジー,そのアプローチとして「飽きない会話は,なぜ飽きないのか」を検討した結果,「欲求」がキーになるのではないかと結束氏は話す。会話で一番大きな要素となるのは「変化」で,対話AIにおいてインタラクティブ性があってもパターンに限りがある場合,変化を感じさせることが難しいのだという。そこで,会話内容を蓄積し,個性や人格を確立させるというアプローチを行っているそうだ。この新しい自由対話AIシステムが「OMOIKANE」だ。

|

|

|

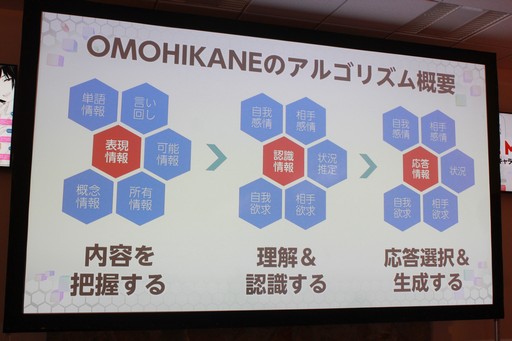

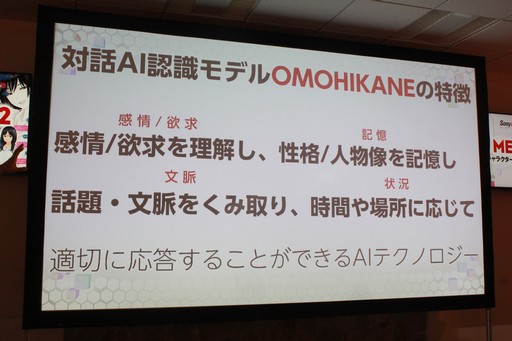

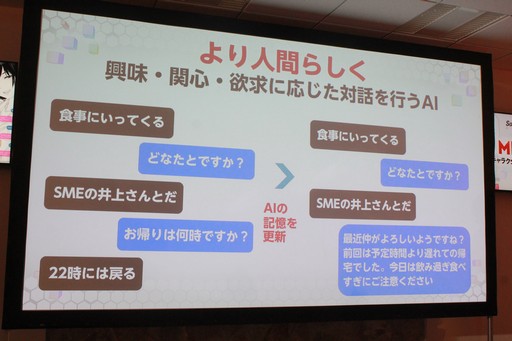

OMOIKANEのアルゴリズムは,まず会話を分析して内容を把握したあと,相手の感情や欲求,さらに推定も含めて内容を理解し,認識する。この認識を元に,記憶情報やAIの性格,機嫌,さらにはキャラクター性なども含めた複数の返却応答候補から,より適切な応答を返却するという。「人間の挙動らしく,理解や認識が同じでも,生成される応答が異なる動作」をするAIだと,結束氏は述べた。

|

|

|

このOMOIKANEは,2018年11月より「PROJECT samantha」としてサービスローンチする予定だ。井上氏は,「引き続きこの新しいシステムと,エンタメスピリットを組み合わせて,もっと面白いものをいっぱい作っていきたいと思います」と述べ,クロストークを締めくくった。

|

- この記事のURL: